Com a discussão da nova reforma de direitos de autor em curso na União Europeia surgiu também a discussão sobre o papel que os algoritmos podem desempenhar na agilização dos processos. Especialmente o Artigo 13 – aquele que acabou por ficar conhecido como “Filtro de Upload” – estabelece uma correspondência objectiva entre o desenvolvimento tecnológico e a aplicação da lei. Em traços largos pode dizer-se que é proposto que se criem algoritmos capazes de detectar aquilo que é ou não legal do ponto de vista do cumprimento dos direitos de autor.

O caso gerou alguma polémica e, entre os “internautas mais experientes” – digamos assim –, é unânime a ideia de que não podemos confiar nos algoritmos. As provas têm surgido recorrentemente, quer dadas pelo novo filtro de censura de pornografia criado pelo Tumblr, quer pelo sistema Content ID do YouTube — a tecnologia que permite aos detentores de direitos de autor reclamar a monetização de conteúdos ou a sua remoção da plataforma —, quer pela aplicação de políticas das redes sociais que usamos todos os dias.

Reunimos cinco exemplos, curtos e simples, que ilustram as zonas cinzentas da capacidade de compreensão das máquinas e evidenciam o porquê de ser uma ideia arriscada pô-las ao serviço do cumprimento de normas em áreas tão disseminadas como a comunicação digital. Quase todos os exemplos cabem num tweet só mas escondem por de trás longas e complexas histórias de reivindicação de direitos autorais.

Uma empresa reclama direitos de autor do silêncio

Este caso parece caricatural e lembra-nos de que podem haver bad actors a tentar tirar partido da subjectividade dos algoritmos. David Hembrow foi a vítima e partilhou tudo no Twitter. Pelo que se pode ler na série de tweets, Hembrow recebeu uma notificação pelo uso indevido de direitos de autor por um vídeo sem som de uma visita de estudo da sua filha. Ao que tudo indica esta deve ser uma reivindicação fraudulenta, provavelmente feita por uma empresa que tenta assumir-se como detentora de direitos de materiais que não são seus, podendo depois lucrar com isso — a reclamação de direitos de autor através do YouTube permite a quem os reivindica ficar com parte do dinheiro feito pelo vídeo em publicidade, divindo-os com o autor.

Ten years ago I accompanied my daughter on a school trip and made this silent video using a camera which didn't record sound. Today, @YouTube allowed an organisation to make a copyright claim over the soundtrack of a SILENT video…https://t.co/DhWsbsr7ilhttps://t.co/UNr8WWYjmf

— David Hembrow (@DavidHembrow) December 9, 2018

A Sony diz ter direitos de autor sobre Bach, que morreu há 300 anos

Este caso é um clássico e ainda mais simples de perceber. A Sony Music Entertainment (SME) alertou um pianista para a correspondência indevida entre 47 segundos de uma gravação sua e material protegido por direitos de autor. Os 47 segundos referiam-se a um trecho da obra de Bach – o compositor que faleceu em 1750 –, tocados na própria casa do pianista James Rhodes, pelo que, sendo provável que a SME tenha editado aquele excerto em alguma das suas compilações, não passa a ser detentora dos direitos de autor da peça em si, podendo qualquer pessoa interpretá-la livremente.

Os direitos de autor sobre a interpretação e sobre a composição são diferentes e Bach é um caso paradigmático. Uma das obras mais famosas de Bach, “Goldeberg Variations”, foi em 2012 gravada pelo pianista Kimiko Douglass-Ishizaka e disponibilizada sobre a licença CC0, ou seja, em domínio público, num exemplo demonstrativo de que funcionam as leis neste domínio.

A composição de “Goldberg Variations” era livre de direitos, mas as interpretações não por serem detidas pelas produtoras ou editoras. Assim bastou ao pianista japonês fazer a sua própria rendição e gravação para que a música chegasse por inteiro ao público em geral.

https://twitter.com/JRhodesPianist/status/1036929244654460928

Tumblr censura e censura denúncia de censura de Cory Doctorow

O filtro que visa bloquear a pornografia no Tumblr foi imposto há muito pouco tempo e, como tal, ainda é provável que ainda não esteja completamente afinado. De qualquer forma é um excelente exemplar para testes em ambiente real da capacidade dos algoritmos para filtrar coisas e tem concentrado algumas atenções e experiências. Algumas delas infortuítas. Foi o que aconteceu com Cory Doctorow.

Tudo começou quando o Tumblr notificou o escritor de que um dos seus uploads feitos há 5 anos infringia as novas regras da comunidade. A fotografia completamente inofensiva e que mencionava o termo “fingerprinting” foi, sem se perceber muito bem porquê, excluída da dimensão pública da rede, mas Doctorow não se ficou por aí. Depois de ver a sua fotografia sinalizada, Cory Doctorow fez uma imagem com texto denunciando o erro do pornbot do Tumblr que acabou também ela sinalizada pelo pornbot do Tumblr… assim sucessivamente numa luta que acabou com um e-mail do Tumblr a assumir que a sinalização tinha sido errónea.

MORE TUMBLR PORN pic.twitter.com/NXzXmXPKV1

— Cory Doctorow AFK (@doctorow) December 11, 2018

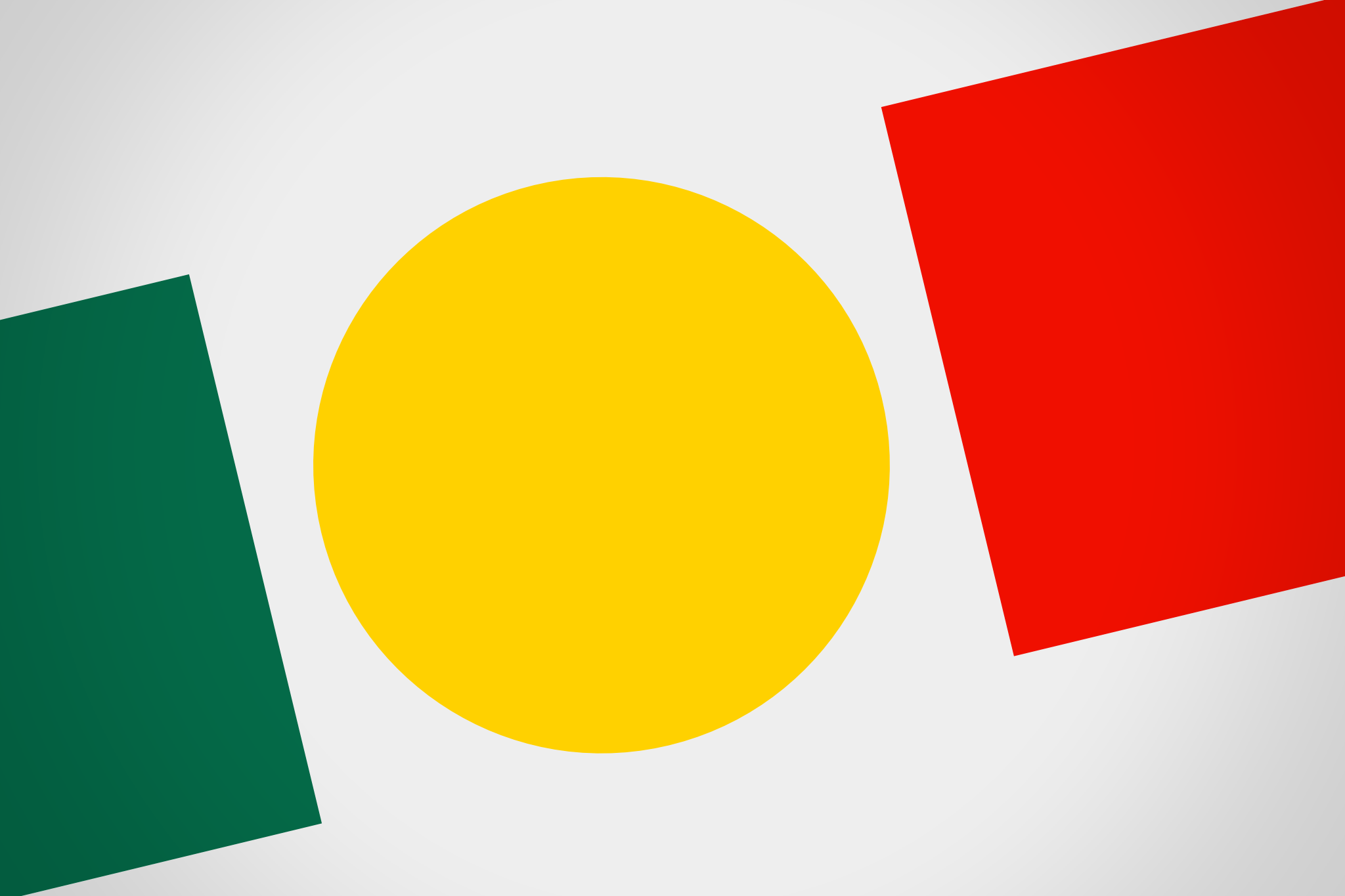

A arte de Tom White

Neste caso pode dizer-se que os algoritmos falham porque são testados ao limite. É essa a arte de Tom White. Professor de design de computação na Universidade de Wellington, na Nova Zelândia, Tom dedica-se a fazer obras de arte mas não quer saber do que os humanos pensam sobre elas. Pelo contrário, está mais interessado em perceber o que pensam os computadores — nomeadamente sobre o seu carácter pornográfico ou violento.

O seu projecto é uma investigação rica que explora com formas abstractas as correspondências estabelecidas pelos algoritmos entre cores, formas e texturas e ambientes da vida real. No fundo, lembra-nos que os algoritmos não vêm nem percebem como nós mas antes por algo semelhante a um exercício de correspondência estatística e uma sequência de probabilidades.

Dropped by @artificialmtl to take a photo of my Mustard Dream print and post it to my tumblr. You won't believe what happened next. pic.twitter.com/Oyoamu5t5x

— dribnet (@dribnet) December 7, 2018

A imagem do Shifter que não é pornografia, é arte

Aconteceu connosco e, com certeza, não somos caso único. Quem publica diariamente nas redes e não tem um absoluto cuidado com todos os milímetros do seu conteúdo arrisca-se a que também aconteça. O algoritmo do Facebook sinalizou a fotografia de destaque do artigo “Mapplethorpe não estava sozinho na missão da subversão” como contendo imagens sexualmente explicitas, mesmo depois com a imagem devidamente alterada recorrendo a pixelização.

O @Facebook decidiu achar que este thumbnail de um artigo do @SHIFTERpt (que até está pixelizado!) é nudez.

Não, Facebook. É arte de 5 fotógrafos tão ou mais controversos do que Mapplethorpe. ALGORITMOS ESTÚPIDOS! Imaginem agora os filtros do Artigo 13… https://t.co/DLOjLCI2Ya pic.twitter.com/o7IaFwlkVk

— Mário Rui André (@mruiandre) December 12, 2018

Estes são exemplos simples, quase banais, mas que nos mostram claramente como será arriscado estabelecer uma correspondência directa entre decisões algorítmicas e a aplicação da lei. Numa altura em que parece que há uma app para tudo, é bom relembrar que nem sempre essa app funciona como queremos e que muitas vezes os bugs levam-nos a lugares estranhos e imprevisíveis — quem diria há seis ou sete anos que ainda íamos culpar o Facebook por resultados de eleições enviesados? Aparentemente nem o próprio Mark Zuckerberg…

Hoje em dia já ninguém o estranha e todos acreditamos que podia ter sido evitado com precauções atempadas. É por isso que é tão importante divulgar casos como este para que não vinguem ideias ilusórias de que a tecnologia nos pode ajudar a resolver problemas como que por magia.

https://shifter.sapo.pt/2018/11/verdade-algoritmos-nice-shit-studio/