Se a Natureza desenvolveu um ser com capacidades de inteligência superiores à das restantes espécies, agora é esse ser – o Homem – que está empenhado em criar e aperfeiçoar a sua própria inteligência artificial. A AI promete complementar o raciocínio e perspicácia humanas, automatizando processos minunciosos ou demorados, podendo por isso tornar-se melhor numa série de situações mais metódicas e sistemáticas. Contudo, confiar em algoritmos não é a melhor ideia. Se é verdade que a inteligência artificial como hoje está desenvolvida já consegue ser útil em inúmeras circunstância, algumas delas surpreendentes, também é verdade que deixa muito a desejar noutras.

No contexto da internet, usada hoje por milhares de milhões de pessoas por todo o mundo, a inteligência artificial pode ser uma forma de mediação e regulação deste colossal mundo sintético e paralelo em que navegamos diariamente. Todavia, é na mediação do conteúdo online que mais vamos vendo a inteligência artificial (os algoritmos) falhar, como estes cinco casos no contexto dos direitos de autor. Há que notar que, ao mesmo tempo, a inteligência artificial há de ter sido verdadeiramente inteligente na identificação de partilhas online protegidas por direitos de autor – o sistema Content ID, do YouTube, é exemplo disso mesmo, sendo capaz de identificar músicas que os utilizadores da plataforma utilizam e pertencem a outros, permitindo a estes decidir se querem retirar esse vídeo do ar ou receber parte das receitas que a pessoa que o carregou poderá fazer.

Nesse sentido, Google, proprietária do YouTube, diz que está a continuar a desenvolver o Content ID, tendo noção das suas fragilidades e da necessidade de um melhor sistema, ainda por cima com o cerco regulatório agora mais apertado na União Europeia.

Outra evidência de algoritmos enviesados chega-nos de uma outra área em que as tecnológicas como a Google/YouTube também têm investido: desinformação. O fact-checking tornou-se uma tendência jornalística – veja-se os novos órgãos de comunicação sociais que surgiram dedicados a essa “disciplina” –, mas também uma solução das plataformas online para combater uma nova era de notícias falsas que elas permitiram. Com o maior número de internautas ligados e a maior predominância da internet na sociedade e esfera política, as notícias falsas tornaram-se uma arma de arremesso e de propaganda para a qual os feeds e os algoritmos, criados à volta de sinais de engagement, não estavam preparados.

Facebook, Twitter, Instagram, WhatsApp… nem mesmo o YouTube; quase nenhuma rede social provou, desde as eleições presidenciais de 2016, ser imune à proliferação de conteúdo propagandístico ou mesmo falso e, perplexas com um problema inimaginável, se calhar há uma década, as empresas responsáveis por essas plataformas desataram a criar mecanismos de resposta e prevenção da circulação de desinformação. Se esses sistemas podem ter bons resultados em algumas situações, noutras nem por isso – tudo por causa da burrice dos algoritmos por detrás.

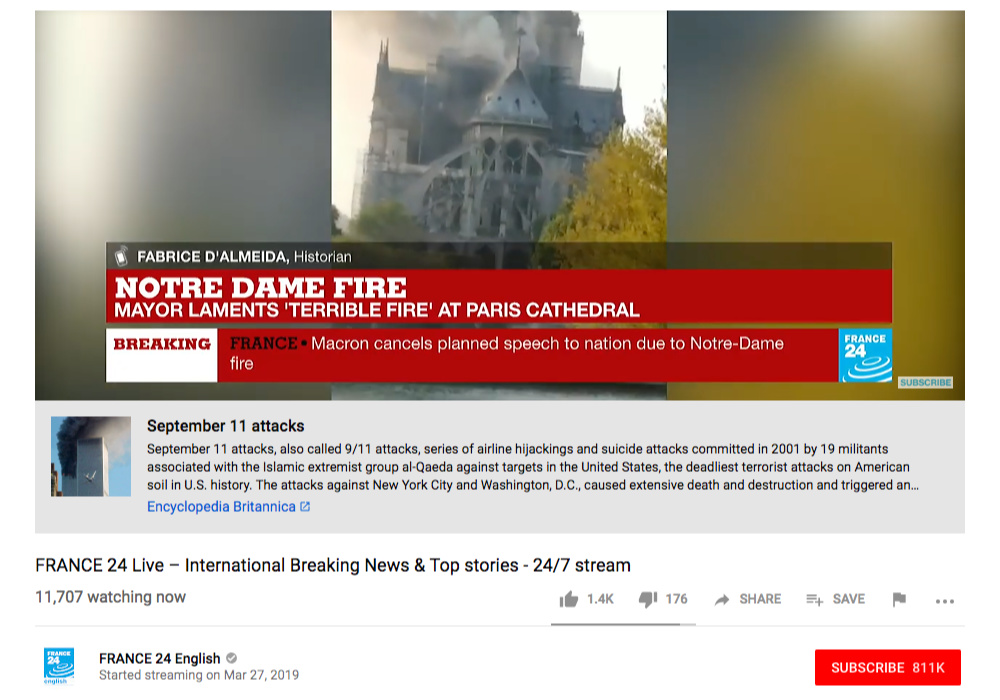

Um exemplo recente chega-nos do incêndio que na tarde desta segunda-feira, 15 de Abril, que consumiu parte da catedral de Notre Dame, na cidade de Paris. O desastre – ainda sem causa determinada, sabendo-se que a catedral estava em obras de renovação – foi acompanhado em directo por órgãos de comunicação social de todo o mundo, incluindo pelo canal noticioso francês FRANCE24, que partilhou a sua emissão televisiva no YouTube.

Todavia, apesar de essa transmissão vir de um órgão fidedigno e confiável como a FRANCE24, os algoritmos do YouTube confundiram o incêndio no Notre Dame com o 11 de Setembro, conforme apontou o BuzzFeed News.

Na parte debaixo do vídeo, o YouTube colocou uma nota sobre os ataques terroristas de 2001 em Nova Iorque, encaminhando os espectadores para uma entrada na Encyclopedia Britannica. O BuzzFeed News diz ter encontrado pelo menos três transmissões em directo do incêndio no Notre Dame com essa chamada de atenção, que acabou por ser removida minutos depois de todos eles.

De acordo com um porta-voz do YouTube, citado pela mesma publicação, esses painéis com o intuito de oferecer aos utilizadores do YouTube contexto sobre alguns vídeos, a partir de informação da Encyclopedia Britannica ou da Wikipédia, “são accionados por algoritmos e nossos sistemas às vezes fazem o cal errado”.

I'm so glad we let tech platforms eat the journalism industry.

Now, I can sit and watch a live stream of Notre Dame burning while YouTube's fake news widget tells me about 9/11 for some reason. pic.twitter.com/FhAtE4DqtB

— Ryan Broderick (@broderick) April 15, 2019

Why in the world is @YouTube putting information about 9/11 underneath the Notre Dame livestream from @FRANCE24?

(Especially since it seems like, at least right now, ongoing renovations are the most likely cause, no indication of terror) https://t.co/A3HP36epxx pic.twitter.com/ZheCMC5pcG

— Joshua Benton (@jbenton) April 15, 2019

Um relatório de 2018 da Pew Research Center dá conta de que o YouTube é o segundo site social preferido pelos norte-americanos para o consumo de informação. Dada essa importância, o YouTube anunciou no ano passado que ia começar a mostrar, nos Estados Unidos, excertos e links para a Wikipedia (e aparentemente também para outras fontes de informação, como a Encyclopedia Britannica) em vídeos relacionados com teorias da conspiração e outros tópicos que acabem por ganhar uma popularidade significativa. Já mais recentemente, o YouTube começou na Índia a partilhar artigos de fact-checking em resultados de pesquisa.

Se essas iniciativas podem ser soluções possíveis e eficazes no combate à desinformação online, há que ter em atenção que os algoritmos ainda podem errar, por vezes de formas extraordinariamente estúpidas. O YouTube e outras tecnológicas ainda continuam à procura das melhores formas para manter os seus espaços sociais seguros e saudáveis, livres não só de materiais falsos ou de propaganda, mas livres também de discussões de ódio, populismos e nacionalismos.

A inteligência artificial poderá tornar-se extremamente eficaz nisso, mas até lá a moderação humana e olho humano vão ter de continuar a ser fundamentais.

https://twitter.com/patrickgaley/status/1117848909877895171

You must be logged in to post a comment.